Comment bien compter les tokens ?

Posté le 1 avril 2025 • 4 min de lecture • 667 motsQuand on utilise ChatGPT ou toute autre API d’OpenAI, une contrainte essentielle est la limite de tokens. Mais qu’est-ce qu’un token ? Comment sont-ils comptés ? Pourquoi est-ce important de les gérer efficacement ?

I. Qu’est-ce qu’un token ?

Un token est une unité de texte que le modèle traite. Il peut s’agir d’un mot entier, d’une partie de mot ou même d’un caractère spécial.

Exemples concrets

| Texte | Nombre de tokens |

|---|---|

| Bonjour | 1 |

| Je suis un développeur | 5 |

| L’intelligence artificielle est fascinante ! | 9 |

| GPT est un modèle puissant. | 6 |

Particularité du découpage des tokens

- En anglais, les mots courts représente 1 token (ex.

"Hello"= 1 token). - En français, certains mots longs peuvent être divisés en plusieurs tokens (ex. “développeur” ou “intelligence”` = 2 tokens).

- La ponctuation comptent aussi comme des tokens.

- Les espaces sont pris en compte avec le mot qui le suit.

- Les acronymes représente 1 token.

En moyenne, 100 tokens correspondent à environ 75 mots, bien que cela puisse varier selon la langue et le style d’écriture.

Fun fact : Un texte en français prend en général plus de tokens qu’en anglais à cause de la structure de la langue.

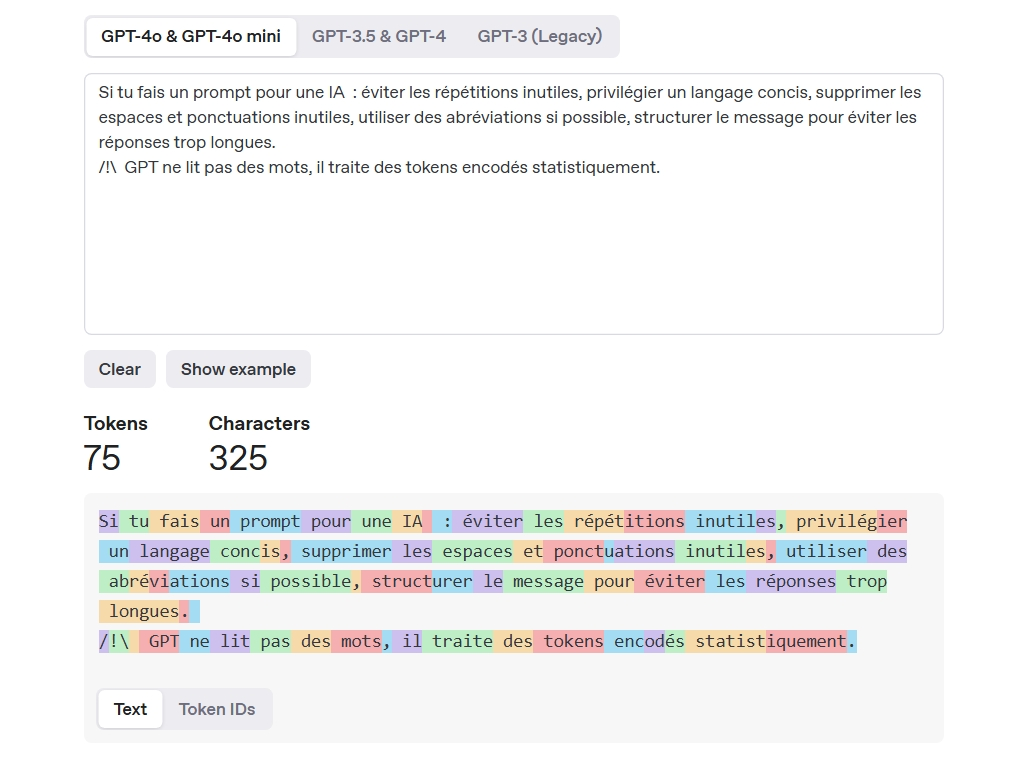

Exemple d’utilisation de openAI, tokenizer

II. Pourquoi compter les tokens est important ?

1. Limiter les coûts d’utilisation

L’API OpenAI facture selon le nombre de tokens consommés. Mieux vaut donc optimiser !

2. Éviter les erreurs d’API

Chaque modèle a une limite de tokens :

- GPT-4 Turbo : 128K tokens max

- GPT-4 : 8K tokens

- GPT-3.5 Turbo : 16K tokens

- o3-mini : 128K tokens

Si tu dépasses cette limite, ta requête sera tronquée ou rejetée.

III. Optimiser le prompt engineering

- Formuler les prompts de façon concise.

- Supprimer les répétitions.

- Éviter les phrases inutiles.

III. Comparaison des modèles GPT et tokens disponibles

Voici un tableau comparatif des principaux modèles, leurs performances, leurs limites de tokens et leurs tarifs :

| Modèle | Max Tokens (entrée + sortie) | Performance | Cas d’utilisation | Tarifs (par million de tokens) |

|---|---|---|---|---|

| GPT-4o | 128K | Modèle multimodal (texte, image, audio) | Applications nécessitant une compréhension multimodale | Entrée : 2,50 $Sortie : 10,00 $ |

| GPT-4o mini | 128K | Version plus légère et économique de GPT-4o | Intégration dans des services avec grand volume d’appels API | Entrée : 0,15 $Sortie : 0,60 $ |

| o3-mini | 128K | Modèle axé sur le raisonnement rapide et économique | Tâches nécessitant un raisonnement efficace à moindre coût | Gratuit dans ChatGPT, payant via API |

| GPT-3.5 Turbo | 16K | Bon équilibre entre coût et performance | Applications interactives, chatbots, synthèses | Entrée : 0,60 $Sortie : 2,40 $ |

À savoir :

- o3-mini est gratuit pour les utilisateurs de ChatGPT (avec certaines limitations), mais payant pour les intégrations via API.

- Plus un modèle a de tokens, plus il peut comprendre du contexte sur une longue conversation.

- Les coûts sont plus élevés pour des modèles puissants comme GPT-4o.

IV. Bonnes pratiques pour optimiser les tokens

Pour éviter d’exploser ton budget ou dépasser les limites, voici quelques astuces :

1. Éviter les répétitions inutiles

❌ Mauvais : "Peux-tu me donner une réponse sur ce sujet et m’expliquer ce sujet en détail ?"

✅ Bon : "Peux-tu détailler ce sujet ?"

2. Privilégier un langage concis

❌ Mauvais : "J’aimerais savoir si tu peux me donner un résumé de ce texte et aussi me dire combien de tokens il contient."

✅ Bon : "Peux-tu résumer ce texte et compter les tokens ?"

3. Supprimer les espaces et ponctuations inutiles

Un espace ou un retour à la ligne en trop peut coûter des tokens !

4. Utiliser des abréviations si possible

Si ton contexte le permet, certaines abréviations réduisent la consommation.

5. Structurer le message pour éviter les réponses trop longues

Si tu fais un prompt pour une IA, précise bien la longueur souhaitée :

"Fais un résumé en 50 mots.""Donne-moi 3 points essentiels."

Conclusion

- Les tokens sont des unités de texte utilisées par ChatGPT et influencent le coût et la limite des requêtes.

- Plusieurs outils permettent de compter les tokens, comme tiktoken en Python ou l’outil OpenAI Tokenizer.

- Il est essentiel d’optimiser la rédaction des prompts pour économiser les tokens et maximiser l’efficacité des requêtes.